NVIDIA เปิดสเปกของเครื่องเซิร์ฟเวอร์ชื่อ MGX ให้ผู้ผลิตเซิร์ฟเวอร์และศูนย์ข้อมูลขนาดใหญ่ใช้งาน

MGX เป็นชื่อเรียกดีไซน์ต้นแบบ (reference architecture) ของเครื่องเซิร์ฟเวอร์ที่ใช้เทคโนโลยีฝั่ง NVIDIA ได้แก่

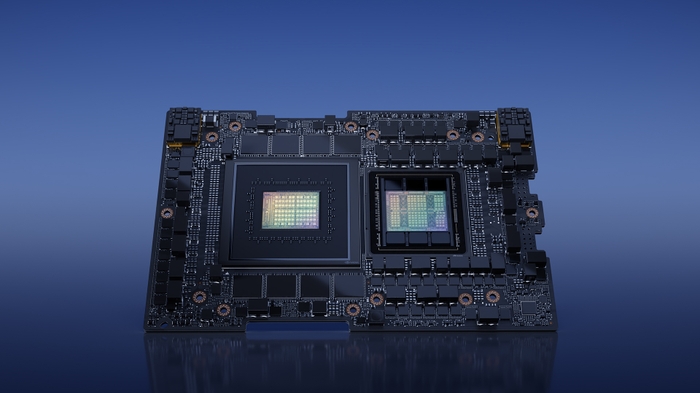

- จีพียู NVIDIA ฝั่งเซิร์ฟเวอร์ทั้งหมด เช่น H100, L40, L4

- ซีพียู รองรับทั้ง x86 ทั่วไป และซีพียู Grace CPU Superchip กับ Grace Hopper Superchip

- ชิปเครือข่าย BlueField-3 DPU, การ์ดเครือข่าย ConnectX-7

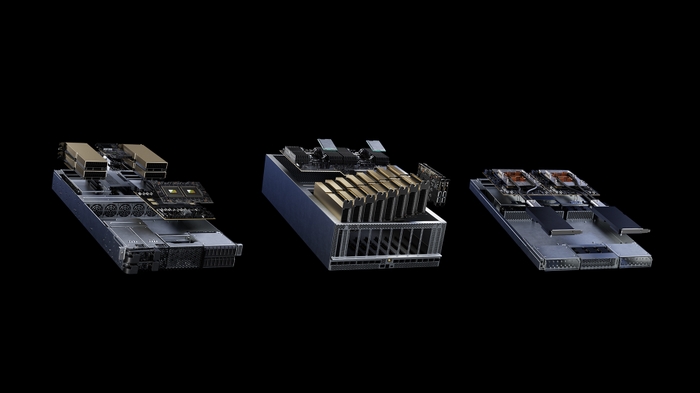

รูปแบบของเซิร์ฟเวอร์ MGX มีทั้งขนาดแร็ค 1U, 2U, 4U และระบายความร้อนได้ทั้งอากาศ-ของเหลว รวมๆ แล้วมีสเปกย่อยมากกว่า 100 แบบ โดย NVIDIA การันตีว่าสเปก MGX จะรองรับสินค้าของตัวเองที่จะออกขายในอนาคต และตัวสเปก MGX ก็เคารพสเปกกลางของ Open Compute Project (OCP) กับ Electronic Industries Alliance เพื่อใช้ร่วมกับเซิร์ฟเวอร์รุ่นอื่นๆ ได้ด้วย

ข้อดีของการออกดีไซน์กลาง MGX คือผู้ผลิตเซิร์ฟเวอร์ประหยัดต้นทุนในการออกแบบเครื่องใหม่ สามารถหยิบสเปกกลางมาปรับแต่งเล็กน้อย แล้วได้สินค้าพร้อมขายเลย (ลักษณะเดียวกับที่ผู้ผลิตซีพียูชอบทำโน้ตบุ๊กต้นแบบให้ด้วย) รายชื่อผู้ผลิตเซิร์ฟเวอร์ที่ประกาศใช้ดีไซน์กลุ่ม MGX แล้วได้แก่ ASRock Rack, ASUS, GIGABYTE, Pegatron, QCT, Supermicro โดยสินค้าของ QCT และ Supermicro จะออกขายในเดือนสิงหาคม

จริงๆ แล้ว NVIDIA มีดีไซน์เซิร์ฟเวอร์อีกตัวคือ HGX ที่จับตลาดสูงกว่า เน้นตลาด high performance computing (HPC) และงานด้าน AI ขนาดใหญ่ ใช้จีพียูหลายตัวและบัสแบบ NVLink แต่ไม่ได้เปิดออกมาให้ใช้ในวงกว้างเหมือนกับ MGX และยังจำกัดเฉพาะผู้ผลิตเซิร์ฟเวอร์บางราย

ที่มา – NVIDIA